Atacul invizibil: Cum manipularea cu deepfake lovește democrația din R. Moldova

În R. Moldova, tehnologia deepfake devine tot mai des o armă digitală în mâinile celor care vor să submineze încrederea în autorități. Într-un val recent de dezinformare, președinta Comisiei Electorale Centrale a fost ținta unui videoclip fals generat de inteligența artificială. Anterior, și președinta Maia Sandu a fost protagonist unor deepfake-uri distribuite pe rețele sociale pentru a crea confuzie și a influența opinia publică înainte de alegeri. Fenomenul, prezent și în alte democrații vulnerabile, ridică urgența educării cetățenilor în fața unei amenințări invizibile. Dacă dezinformarea, inclusiv prin intermediul deepfake-urilor, prinde rădăcini, o democrație poate eșua, treptat, până la punctul în care este schimbată cu un regim hibrid, consideră unii experți.

În ultima perioadă, R. Moldova a fost martora unei intensificări a utilizării tehnologiei deepfake, în special în context politic, cu scopul de a manipula opinia publică și de a submina încrederea în instituțiile democratice.

La sfârșitul lunii mai, pe un canal de Telegram a fost publicat un deepfake al cărei protagostă era președinta Comisiei Electorale Centrale, Angelica Caraman, care „confirma” și chiar „aproba” într-o emisiune de la Jurnal TV interferența conducerii franceze în alegerile din Republica Moldova.

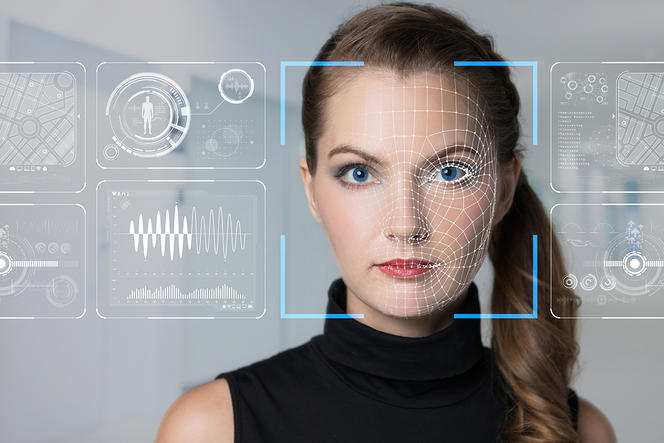

Ce este un deepfake?

Un deepfake este un conținut digital manipulat cu ajutorul inteligenței artificiale (IA), care poate înlocui fețele, vocile sau gesturile unei persoane reale cu cele ale altei persoane, creând astfel imagini, videoclipuri sau înregistrări audio false, dar extrem de convingătoare. Tehnologia utilizează rețele neuronale și algoritmi de învățare profundă pentru a genera aceste falsuri sofisticate.

Deepfake-uri în Republica Moldova

În ultimii ani, Republica Moldova a fost ținta unor campanii de dezinformare care au folosit tehnologia deepfake pentru a influența opinia publică și procesul electoral.

Președinta Maia Sandu a fost constant în ultimii ani protagonist deepfake-urilor. Înaintea alegerilor locale din noiembrie 2023, pe Facebook a apărut un video fals, în care președinta Sandu chipurile s-ar referi la „situația dezastruoasă” din țară și la „îngroparea democraţiei”, chemând electoratul să voteze candidatul Partidului „Renaştere”, care este un satelit al Partidului Șor, declarat neconstituțional și interzis în R. Moldova.

Au apărut videoclipuri în care Maia Sandu ar fi promovat investiții într-o platformă financiară, promițând câștiguri lunare de 30.000 de lei. Acestea erau, de asemenea, deepfake-uri menite să inducă în eroare cetățenii.

La sfârșitul anului 2024, pe un canal de Telegram a apărut un videoclip deepfake în care președinta Maia Sandu părea să felicite în mod sarcastic moldovenii cu ocazia Revelionului și să îndemne cetățenii să o voteze în următoarele alegeri prezidențiale. Videoclipul, realizat cu ajutorul inteligenței artificiale, a fost rapid raportat de Președinție ca fiind fals, avertizând că astfel de materiale au scopul de a crea neîncredere și dezbinare în societate.

În ianuarie 2025, a circulat pe rețelele sociale un alt videoclip deepfake, în care președinta Maia Sandu părea să declare că fondurile destinate educației au fost redirecționate către înarmare. Acest videoclip, deși prezentat într-un ton satiric, a fost parte a unei campanii de dezinformare menite să submineze încrederea în guvern și să promoveze narațiuni false despre pregătirea Moldovei pentru război.

Exemple internaționale

Deepfake-urile au fost folosite și în alte țări pentru a influența opinia publică. Spre exemplu în Taiwan, în timpul alegerilor de anul trecut, un grup afiliat Partidului Comunist Chinez a distribuit un audio deepfake în care un politician influent părea să susțină un alt candidat. Acest audio a fost ulterior eliminat de pe platforme pentru că era fals.

În Noua Zeelandă, o membră a parlamentului a prezentat un deepfake nud cu ea însăși pentru a evidenția pericolele tehnologiei și a solicita reglementări mai stricte.

În Statele Unite, în ianuarie 2024, alegătorii din New Hampshire au primit apeluri telefonice automate în care o voce ce părea a fi a președintelui Joe Biden îi îndemna să nu voteze în alegerile primare democrate, sugerând că ar trebui să „salveze votul pentru noiembrie”. Aceste apeluri au fost create cu ajutorul inteligenței artificiale, folosind tehnologia de clonare vocală de la ElevenLabs. Steven Kramer, un consultant politic, a recunoscut că a comandat aceste apeluri pentru a evidenția pericolele AI-ului, dar a fost ulterior acuzat de 13 infracțiuni de suprimare a votului și amendat cu 6 milioane de dolari de către Comisia Federală pentru Comunicații.

În martie 2022, un videoclip deepfake a fost difuzat online, în care președintele ucrainean Volodîmîr Zelenski părea să îndemne cetățenii să se predea în fața invaziei ruse. Videoclipul a fost rapid demascat ca fiind fals și eliminat de pe platformele sociale, dar a evidențiat modul în care tehnologia poate fi folosită pentru a submina moralul național în timpul conflictelor.

În martie 2024, înaintea alegerilor prezidențiale din Slovacia, o înregistrare audio deepfake a fost distribuită online, în care un candidat părea să se laude că a manipulat alegerile și a crescut prețul berii. Deși autenticitatea înregistrării a fost contestată, incidentul a generat confuzie și a ridicat semne de întrebare cu privire la influența deepfake-urilor asupra rezultatelor electorale.

Utilizarea deepfake-urilor în campaniile electorale

Directoratul Național de Securitate Cibernetică (DNSC) din România avertizează că tehnologia deepfake poate fi folosită în campaniile electorale pentru:

- Discreditarea politicienilor: Crearea de videoclipuri false care prezintă lideri politici în situații compromițătoare;

- Manipularea alegătorilor: Difuzarea de mesaje false atribuite unor candidați pentru a influența votul;

- Răspândirea dezinformării: Generarea de conținut fals pentru a crea confuzie și a submina încrederea în procesul democratic.

DNSC a publicat un ghid în care explică de ce anume deepfake-urile reprezintă un pericol în context electoral. Potrivit sursei, cele mai răspândite tehnici deepfake utilizate pentru a influența campanii electorale sunt:

• Falsificarea video realistă. Algoritmi avansați de inteligență artificială creează videoclipuri aproape imposibil de distins de cele reale, prezentând scene false cu politicieni sau evenimente inventate.

• Clonarea vocii și falsuri audio. Vocea unui politician este reprodusă cu o precizie uimitoare, generând mesaje false atribuite în mod eronat persoanei respective.

• Generarea de text sintetic. Texte credibile sunt create imitând stilul și tonul unei personalități politice sau a unei instituții, răspândind dezinformare.

• Schimbarea fețelor. Tehnologia permite modificarea fețelor în videoclipuri, creând scenarii false care nu s-au petrecut niciodată sau nu în contextul prezentat.

• Predicția comportamentală. Inteligența artificială analizează comportamentul online pentru a prezice răspunsul la anumite mesaje, facilitând crearea de deepfake-uri țintite pentru a influența segmente specifice de alegători.

„Dacă dezinformarea, inclusiv prin intermediul deepfake-urilor, prinde rădăcini, o democrație poate eșua”

Deepfake-ul este și mai periculos pentru că este un fals cu un grad mai înalt de credibilitate, fiind mai dificil de depistat cu ochiul liber, spune redactorul-șef al portalului Stopfals.md, Mihai Avasiloaie.

„Dezinformarea în general este periculoasă pentru democrație, întrucât tinde să erodeze bazele acesteia, iar când vine vorba despre tehnologii avansate de dezinformare, lucrurile se complică și mai mult. Cred că majoritatea am fost martori, în discuții despre politică sau alegeri, la situații în care cineva repeta un fals, argumentând că l-a văzut la televizor sau pe TikTok. În zilele noastre, utilizatorii de internet care nu știu să depisteze un deepfake pot cădea ușor pradă dezinformării, iar acest lucru este îngrijorător. Doar imaginați-vă ce poate face un anunț fals atribuit șefei statului, de exemplu, distribuit masiv în spațiul online, într-o societate cu un nivel redus de educație mediatică.

Este important să fim din ce în ce mai atenți, având în vedere că dezinformarea și tehnicile acesteia se dezvoltă (cel puțin) direct proporțional cu dezvoltarea tehnologiei informaționale. Dacă dezinformarea, inclusiv prin intermediul deepfake-urilor, prinde rădăcini, o democrație poate eșua, treptat, până la punctul în care este schimbată cu un regim hibrid sau chiar dictatorial”, punctează Mihai Avasiloaie.

Cum să recunoaștem un deepfake

Pentru a identifica un posibil deepfake, fiți atenți la următoarele semne:

- Mișcări faciale nefirești: Sincronizarea buzelor cu vocea poate fi imperfectă.telex.md

- Detalii anormale: Privire fixă, clipit rar sau expresii faciale rigide.

- Anomalii vizuale: Degete în plus, fundaluri distorsionate sau artefacte vizuale.

- Inconsecvențe în voce: Tonalitate ciudată sau intonație nenaturală.

- Lipsa sursei oficiale: Verificați dacă informația provine de la o sursă de încredere sau un canal oficial .

Sfaturi pentru utilizatori neinițiați

- Verificați sursa: Nu credeți imediat ce vedeți online. Căutați confirmări din surse oficiale sau mass-media de încredere.

- Fiți sceptici: Dacă un videoclip sau o declarație pare prea șocantă sau neobișnuită, există șanse mari să fie falsă.

- Utilizați instrumente de verificare: Există aplicații și extensii de browser care pot ajuta la detectarea deepfake-urilor.

- Educați-vă: Înțelegerea modului în care funcționează tehnologia deepfake vă poate ajuta să fiți mai pregătiți să o identificați.

- Raportați conținutul suspect: Dacă întâlniți un posibil deepfake, raportați-l platformei pe care l-ați găsit și informați autoritățile competente.

Acest material a fost produs cu suportul financiar al Uniunii Europene. Conținutul acestuia reprezintă responsabilitatea exclusivă a proiectului „Consolidarea rezilienței de sus în jos și de jos în sus în Republica Moldova”, cofinanțat de Uniunea Europeană. Conținutul materialului aparține autorilor și nu reflectă în mod neapărat viziunea Uniunii Europene.